編輯:關於Android編程

基礎知識

度量聲音強度,大家最熟悉的單位就是分貝(decibel,縮寫為dB)。這是一個無綱量的相對單位,計算公式如下:

![]()

分子是測量值的聲壓,分母是參考值的聲壓(20微帕,人類所能聽到的最小聲壓)。因此日常中說道聲音強度是多少多少分貝時,都是默認了一個很小的參考值的。

而Android設備傳感器可以提供的物理量是場的幅值(amplitude),常用下列公式計算分貝值:

![]()

從SDK中讀取了某段音頻數據的振幅後,取最大振幅或平均振幅(可以用平方和平均,或絕對值的和平均),代入上述公式的A1。

現在問題是,作為參考值的振幅A0取多少呢?

博主查閱很多帖子、博文,這裡是最一團漿糊的地方。有的博文取600,是基於它視噪音的振幅為600的假設,此時算出來的是相對背景噪音的分貝值,要是用戶不對麥克風發出聲音,算出的基本都是0分貝。而用戶實際使用場景下的背景噪音大小千差萬別,咱要是也照葫蘆畫瓢就不對了,尤其是對於那些制作絕對分貝計的需求,應找出20微帕聲壓值對應的振幅(或者也可以拿一個標准分貝計做校准參考)。

博主比較懶,把A0定為1,即Android設備麥克風所能”聽“到的最小聲音振幅。這樣拿到測量值振幅直接代入第二個公式的A1中,即可算出分貝值了。

Android API

使用麥克風需要在AndroidManifest.xml裡申請相應權限:

復制代碼 代碼如下:

<uses-permission android:name="android.permission.RECORD_AUDIO" />

能夠獲得音源數據的類有兩個:android.media.MediaRecorder和android.media.AudioRecord。

MediaRecorder:

這個類的對象初始化比較麻煩,因為它是被設計用來錄制一段完整的音頻並寫入文件系統中的。但是初始化之後獲得振幅卻比較方便,我們直接用它的無參方法getMaxAmplitude即可獲得一小段時間內音源數據中的最大振幅。不過取最大值的可能弊端是會受到極端數據的影響,使得後來計算的分貝值波動比較大。不過這個方法是很多錄音應用計算音量等級所采用的辦法。

該方法返回的是0到32767范圍的16位整型,原理可能是對一段值域為-32768到32767的音源數據取其中絕對值最大的值並返回。這個值與單位為帕斯卡的聲壓值是有線性函數關系的。另外需要注意的是第一次調用這個方法取得的值是0,代入公式中算出的分貝值是負無窮大,故需要在代碼中對這種情況做判斷。可以算出,由於getMaxAmplitude返回的數值最大是32767,因此算出的最大分貝值是90.3。也就是說,博主令參考振幅值為1,計算出的分貝值正常值域為0 dB 到90.3 dB。

演示代碼如下,基於hongfa.yy的代碼改寫:

package com.example.myapp;

import java.io.File;

import java.io.IOException;

import android.media.MediaRecorder;

import android.os.Handler;

import android.util.Log;

/**

* amr音頻處理

*

* @author hongfa.yy

* @version 創建時間2012-11-21 下午4:33:28

*/

public class MediaRecorderDemo {

private final String TAG = "MediaRecord";

private MediaRecorder mMediaRecorder;

public static final int MAX_LENGTH = 1000 * 60 * 10;// 最大錄音時長1000*60*10;

private String filePath;

public MediaRecorderDemo(){

this.filePath = "/dev/null";

}

public MediaRecorderDemo(File file) {

this.filePath = file.getAbsolutePath();

}

private long startTime;

private long endTime;

/**

* 開始錄音 使用amr格式

*

* 錄音文件

* @return

*/

public void startRecord() {

// 開始錄音

/* ①Initial:實例化MediaRecorder對象 */

if (mMediaRecorder == null)

mMediaRecorder = new MediaRecorder();

try {

/* ②setAudioSource/setVedioSource */

mMediaRecorder.setAudioSource(MediaRecorder.AudioSource.MIC);// 設置麥克風

/* ②設置音頻文件的編碼:AAC/AMR_NB/AMR_MB/Default 聲音的(波形)的采樣 */

mMediaRecorder.setOutputFormat(MediaRecorder.OutputFormat.DEFAULT);

/*

* ②設置輸出文件的格式:THREE_GPP/MPEG-4/RAW_AMR/Default THREE_GPP(3gp格式

* ,H263視頻/ARM音頻編碼)、MPEG-4、RAW_AMR(只支持音頻且音頻編碼要求為AMR_NB)

*/

mMediaRecorder.setAudioEncoder(MediaRecorder.AudioEncoder.AMR_NB);

/* ③准備 */

mMediaRecorder.setOutputFile(filePath);

mMediaRecorder.setMaxDuration(MAX_LENGTH);

mMediaRecorder.prepare();

/* ④開始 */

mMediaRecorder.start();

// AudioRecord audioRecord.

/* 獲取開始時間* */

startTime = System.currentTimeMillis();

updateMicStatus();

Log.i("ACTION_START", "startTime" + startTime);

} catch (IllegalStateException e) {

Log.i(TAG,

"call startAmr(File mRecAudioFile) failed!"

+ e.getMessage());

} catch (IOException e) {

Log.i(TAG,

"call startAmr(File mRecAudioFile) failed!"

+ e.getMessage());

}

}

/**

* 停止錄音

*

*/

public long stopRecord() {

if (mMediaRecorder == null)

return 0L;

endTime = System.currentTimeMillis();

Log.i("ACTION_END", "endTime" + endTime);

mMediaRecorder.stop();

mMediaRecorder.reset();

mMediaRecorder.release();

mMediaRecorder = null;

Log.i("ACTION_LENGTH", "Time" + (endTime - startTime));

return endTime - startTime;

}

private final Handler mHandler = new Handler();

private Runnable mUpdateMicStatusTimer = new Runnable() {

public void run() {

updateMicStatus();

}

};

/**

* 更新話筒狀態

*

*/

private int BASE = 1;

private int SPACE = 100;// 間隔取樣時間

private void updateMicStatus() {

if (mMediaRecorder != null) {

double ratio = (double)mMediaRecorder.getMaxAmplitude() /BASE;

double db = 0;// 分貝

if (ratio > 1)

db = 20 * Math.log10(ratio);

Log.d(TAG,"分貝值:"+db);

mHandler.postDelayed(mUpdateMicStatusTimer, SPACE);

}

}

}

AudioRecord:

這個類可以獲得具體的音源數據值。將一段音源數據用read(byte[] audioData, int offsetInBytes, int sizeInBytes)方法從緩沖區讀取到我們傳入的字節數組audioData後,便可以對其進行操作,如求平方和或絕對值的平均值。這樣可以避免個別極端值的影響,使計算的結果更加穩定。求得平均值之後,如果是平方和則代入常數系數為10的公式中,如果是絕對值的則代入常數系數為20的公式中,算出分貝值。

演示代碼如下:

package com.example.myapp;

import android.media.AudioFormat;

import android.media.AudioRecord;

import android.media.MediaRecorder;

import android.util.Log;

/**

* Created by greatpresident on 2014/8/5.

*/

public class AudioRecordDemo {

private static final String TAG = "AudioRecord";

static final int SAMPLE_RATE_IN_HZ = 8000;

static final int BUFFER_SIZE = AudioRecord.getMinBufferSize(SAMPLE_RATE_IN_HZ,

AudioFormat.CHANNEL_IN_DEFAULT, AudioFormat.ENCODING_PCM_16BIT);

AudioRecord mAudioRecord;

boolean isGetVoiceRun;

Object mLock;

public AudioRecordDemo() {

mLock = new Object();

}

public void getNoiseLevel() {

if (isGetVoiceRun) {

Log.e(TAG, "還在錄著呢");

return;

}

mAudioRecord = new AudioRecord(MediaRecorder.AudioSource.MIC,

SAMPLE_RATE_IN_HZ, AudioFormat.CHANNEL_IN_DEFAULT,

AudioFormat.ENCODING_PCM_16BIT, BUFFER_SIZE);

if (mAudioRecord == null) {

Log.e("sound", "mAudioRecord初始化失敗");

}

isGetVoiceRun = true;

new Thread(new Runnable() {

@Override

public void run() {

mAudioRecord.startRecording();

short[] buffer = new short[BUFFER_SIZE];

while (isGetVoiceRun) {

//r是實際讀取的數據長度,一般而言r會小於buffersize

int r = mAudioRecord.read(buffer, 0, BUFFER_SIZE);

long v = 0;

// 將 buffer 內容取出,進行平方和運算

for (int i = 0; i < buffer.length; i++) {

v += buffer[i] * buffer[i];

}

// 平方和除以數據總長度,得到音量大小。

double mean = v / (double) r;

double volume = 10 * Math.log10(mean);

Log.d(TAG, "分貝值:" + volume);

// 大概一秒十次

synchronized (mLock) {

try {

mLock.wait(100);

} catch (InterruptedException e) {

e.printStackTrace();

}

}

}

mAudioRecord.stop();

mAudioRecord.release();

mAudioRecord = null;

}

}).start();

}

}

實測結果(設備小米2S),MediaRecorderDemo波動很大,只要對麥克風一吹氣,分貝值就能上90:

而AudioRecordDemo就很穩定了,很用力吹氣也很難到88以上:

Android優化——UI優化(三)

Android優化——UI優化(三)

使用ViewStub延遲加載1.ViewStub延遲加載 ViewStub是一個不可見的,大小為0的View,最佳用途就是實現View的延遲加載,在需要的時候再加載Vie

Android Studio下自動生成UML圖

Android Studio下自動生成UML圖

畫類圖是一件挺麻煩的事情。如果有工具能自動生成類圖,那有多好!簡單搜索了一下,還真有。AS (2.1)下面搞一個插件code iris就可以自動生成。1 插件安裝安裝很簡

Android - 本地驗證碼的生成

Android - 本地驗證碼的生成

android客戶端生成本地驗證碼主要用來限制用戶隨意按請求按鈕,其實該示例也是來對自定義view的練練手而已,先給出效果圖吧其中可定制:*干擾線數目*干擾點數目*背景顏

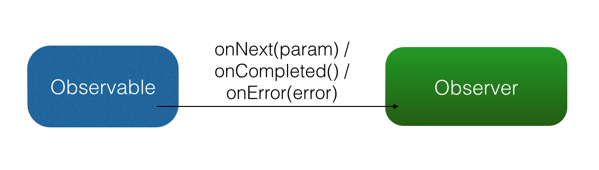

RxJava菜鳥驿站(一)

RxJava菜鳥驿站(一)

前言終究沒有經受住RxJava的誘惑,只恨自己來的比較晚,走起~RxJava 是什麼?一個在 Java VM 上使用可觀測的序列來組成異步的、基於事件的程序的庫~Rx J